A világ megint úgy szalad el mellettünk, hogy itt a turulos, vármegyés, hátrafele-nyilazós múltbarévedésben ebből semmit nem is veszünk észre.

Olyan szintű exponenciálisok pörögnek minden fejlődésről készült grafikonokon, amit már ábrázolni sem tudnak érthetően.

Én is próbálom laikusként követni a fejlesztési irányokat, hogy valami halvány elképzelésem legyen erről a várható forradalomról.

Úgy látszik Harari is olvassa a blogomat, mert a demokráciáról írt szösszenetemet pár hónap csúszással gyakorlatilag visszamondta a Telegraph-nak adott interjúban. 🙂

A 444-en megjelent egy egész jól összeszedett cikk, ami szerintem rengeteg olyan tényt és problémát felvet, ami mellett nem dughatjuk homokba a fejünket.

Tudom, hogy a hideg fut a hátadon, ha azt mondom KÖTELEZŐ. Én végignéztem a beágyazott Youtube-os prezentációt is és elállt a lélegzetem. Én is úgy gondolom, hogy az informatika, az internet fejlődése alig valami változást hozott a világban ahhoz képest, ami most várható. Nem holnap csütörtökön, de talán EGY-KÉT HÓNAP múlva, ha robban…

De nem véletlenül szedtem ki és tettem ide a teljes, védett tartalmat is.

Ez még nem a világvége, de az eddig ismert világunknak vége

- Annyira gyorsan fejlődik az új típusú mesterséges intelligencia, hogy a fejlesztői sem bírják követni.

- Rengetegen kongatják is a vészharangot, de a szellem már minden jel szerint kiszabadult a gépből.

- Beléptünk az emberiség új, minden korábbinál bizonytalanabb korszakába, és úgy tűnik, hogy ami most következik, az minden ígéretével együtt egészen félelmetes lesz.

Az AI-kutatók fele úgy véli, legalább 10 százalék az esélye annak, hogy az emberi civilizáció elpusztul, mert képtelenek leszünk irányítani a mesterséges intelligenciát.

Ezzel a közvélemény-kutatási adattal kezdődik két etikus AI-kutató, a Center for Human Technology alapítói, Tristan Harris és Aza Raskin márciusban San Franciscóban tartott előadása. Arra figyelmeztettek, hogy sokkal nagyobb sebességgel változik körülöttünk a technológia, mint valaha, és az irányítás már ki is csúszott a kezeink közül.

„Ha minden második hozzáértő mérnök azt állítaná, hogy 10 százaléknál több esélye van annak, hogy a repülő, amire felszállunk, lezuhan, vajon felülnénk-e arra a gépre?” – teszik fel ugyanezt a kérdést másképpen a kutatók, akik szerint az egyetlen felelős válasz egy határozott nem.

Tristan Harris, a Google egykori fejlesztője fontos szerepet játszott a nagy sikerű Social Dilemma című dokumentumfilm elkészítésében, az állatok kommunikációjának dekódolásával foglalkozó Aza Raskin pedig évek óta használja az AI-t (mesterséges intelligenciát, azaz MI-t) saját kutatási területén. A két kutatót Steve Wozniak, az Apple társalapítója konferálta fel.

Mindketten azt állítják, hogy az új típusú AI-rendszerek paradigmaváltást hoznak, nemcsak az informatika, de a politika, a kultúra, a társas kapcsolataink, az intim szféránk, a ma ismert valóságunk érzékelése, voltaképpen az élet minden területén. És egyre több kutató állítja ugyanezt, köztük a világ legismertebb filozófusai és történészei is.

Mind arra figyelmeztetnek: óriási erőfeszítést követel majd tőlünk megérteni és feldolgozni, milyen alapvetően változik meg a világ. Harris egyenesen az 1940-es évekhez méri a most zajló változások paradigmatikus jelentőségét: szerinte az új típusú mesterséges intelligenciákkal az emberiség hasonlóan kockázatos felfedezést tett az elmúlt években, mint a II. világháború idején a nukleáris fegyverkezés területén.

De mi is ez a felfedezés?

Jön a Golem

A kép- és hangfelismerés, illetve -generálás, a gépi látás (computer vision), az agy idegi aktivitását vizualizáni képes funkcionális MRI vagy a robotika területén hosszú évek óta zajlik különböző mesterséges intelligenciák fejlesztése és trenírozása.

A legújabb képgeneráló alkalmazások (mint a Dall-E) például gigantikus méretű grafikus adatbázisok és kreatív kapacitások közös felhasználásával hoznak létre teljesen eredeti (újszerű) képanyagokat szöveges utasítások alapján.

A pápa pufikabátja csak a kezdet volt. A fejlődés sebességét jól érzékelteti az alábbi kép, aminek a bal oldalát a Midjourney képgeneráló tavaly márciusban, a jobb oldalát pedig idén márciusban rajzolta meg, ugyanarra a szöveges utasításra:

Forrás

A gépi tanulás területén korábban több tudományág párhuzamosan fejlődött. Az áttörés 2017-ben jött el, amikor a hosszú időn keresztül külön pályán fejlődő intelligenciákat sikerült közös kódrendszerbe integrálni. Az így létrejött szuperintelligencia azóta hiányzó szöveg-, kép-, hang- vagy mozgóképelemek, de akár DNS-láncolatok elemeit is képes legenerálni és logikai rendszerbe rendezni.

Az egymással párhuzamosan fejlődő intelligenciákat immár ugyanaz a jelrendszer szervezi össze, ami az egyetemes emberi kultúrát, a társas kapcsolatainkat, sőt, vallásainkat, törvényeinket, vagyis az emberi létezés mindennapos valóságát:

a nyelv.

Innentől a cikk csak a Kör tagjainak olvasható.

A legújabb mesterséges intelligencia a nyelv mint formula és értelmezési eszköz segítségével nemcsak használja az integrált kompetenciákat, de képes azokat önállóan is fejleszteni. Az informatikai szakirodalom az így létrejövő szuperintelligenciát Generative Large Language Multi-modal Model (GLLMM) néven, más néven LLM-alapú intelligenciaként hivatkozza. Harrisék csak úgy emlegetik: a Golem. (A gólem a zsidó folklórban varázsigékkel életre keltett agyagember.)

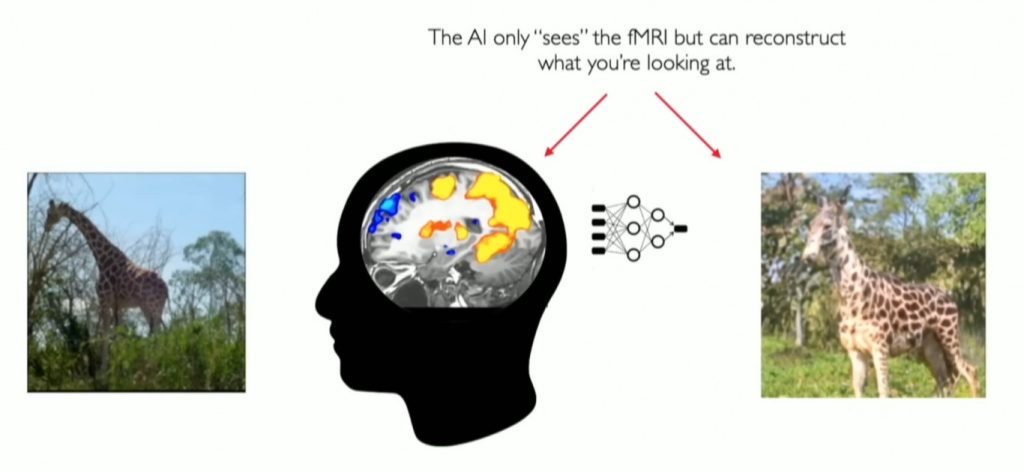

Az előadók több példát hoznak, hogy az áttörés átélhető legyen. Az LLM-típusú (nagy nyelvi modellekre építő) rendszerek képesek alig 3 másodperces minta felhasználásával tökéletesen lemodellezni egy emberi hangot, és abból az eredetihez megtévesztésig hasonlító mintákat előállítani. Ehhez nem kell más, csak egy jól fejlett AI és egy kellően precíz szöveges utasítás. Az ilyen készségeket használó, unokázós csalások és megtévesztések már a jelenben zajlanak, nem a jövőben. De legalább ennyire hatásos példa az, hogy egy MRI-készülékre kötve a legújabb AI képes az agyban zajló folyamatokat lemodellezni, az alapján leírni, mire gondol az adott ember, majd meg is rajzolni, mit lát:

Fotó: Center for Humane Technology/Youtube

Az LLM új minőséget jelent a mesterséges intelligenciák területén: egy komplexebb, a korábbinál sokkal gyorsabban fejlődő rendszert, ami képes az önálló, gépi tanulásra is. A szakértők szerint ez a nyelvi alapú AI paradigmatikus változást hozhat a technológia történetében.

Raskinék figyelmeztetnek, hogy minden változás, ami a valóságunkat alapjaiban fel tudja forgatni, új típusú felelősségeket hoz magával. Az új technológia új versenyhelyzetet teremt, ami pedig megköveteli a versenykörnyezet újraszabályozását is. A gond az AI esetében az, hogy olyan sebességgel zajlik a technológiai forradalom, hogy azt maguk a fejlesztők sem képesek kontrollálni.

Első találkozásaink a mesterséges intelligenciával

Hogy a jelenséggel járó kockázatokat felfogjuk, érdemes visszakanyarodni a mesterséges intelligenciával történt első találkozásunkhoz: a közösségi média térnyeréséhez.

A 2000-es évek közepétől a Facebook, a Youtube és az Instagram eredeti küldetése az volt, hogy összekapcsoljon embereket, hangot adjon kisebb közösségeknek, segítsen beindítani kisvállalkozásokat vagy egymásra találni hasonlóan gondolkodó usereket. A közösségi média ezt az eredeti küldetését többé-kevésbé be is teljesítette.

A probléma az előzetesen nem kalkulálható következményekből adódott. A profitorientált szolgáltatók azzal tudták megtartani a felhasználóikat, hogy célzott algoritmusokkal magukhoz láncolták a figyelmüket. A legegyszerűbb – jórészt a felhasználói szokások mintáira építő – algoritmusok is kellően intelligensnek bizonyultak ahhoz, hogy átalakítsák a társadalmi berendezkedésünk legalapvetőbb formáit.

A demokratikus nyilvánosság széttöredezése, a választási manipulációk gyakorlata, a buborékhatás, a politikai polarizáció, a fake news, az információs túltermelés, a deepfake elterjedése, a doomscrollozás, a fiatalkori mentális- és testképzavar vagy az ADHD (figyelemhiányos hiperaktivitási zavar) tömegessé válása mind azt bizonyítják, hogy

még a közösségi médiát működtető, viszonylag primitív algoritmusok is képesek voltak alapjaiban megváltoztatni mindennapi valóságunkat.

A közösségi platformok ezalatt mélyen behálózták a társadalom szöveteit: a politika és a média logikája, a nemzetbiztonság és az adatvédelem sztenderdjei, a társas kapcsolatok természete és a valóságérzékelésünk is átalakult. Mindez azt mutatja, hogy a mesterséges intelligenciák akkor is képesek megváltoztatni a környezetünket, ha a fejlesztőiknek ez nem feltétlenül állt szándékukban. A következmények előzetesen megjósolhatatlanoknak tűntek, most pedig már visszafordíthatatlannak látszanak.

Az LLM-alapú intelligenciák 2017 óta sorra érnek el áttöréseket, és ez a folyamat mostanra paradigmaváltást eredményezett.

A ChatGPT két hónap alatt 100 millió felhasználót elérve minden idők leggyorsabban fejlődő és terjedő applikációja lett. Az emberiség nagy tömege a mesterséges intelligencia új fajtájával találkozott. Csakhogy ez az intelligencia nagyságrendekkel fejlettebb a közösségi platformok algoritmusainál.

Az LLM-alapú intelligencia minden korábbinál gyorsabban ír, kódol, old meg tudományos problémákat. Rengeteg mindenben az emberiség hasznára válhat majd – ahogy fejlődik, megoldást kínálhat globális kihívásokra is: segítségünkre lehet a klímaváltozás, az egészségügyi logisztika vagy az energiahatékonyság területén. De akárcsak a közösségi média, úgy az LLM-alapú intelligencia esetében is számos olyan következménnyel kell számolni, amivel a fejlesztőik sem feltétlenül lehetnek tisztában.

Mi lesz a munkahelyekkel és a munka nélkül maradó emberek tömegeivel? Mi lesz a személyes és nemzeti információbiztonságunkkal? Hogyan alakul át a valóságérzékelésünk a biotechnológia és az informatika egymásra találásának idején? A figyelemgazdaság és a totális megfigyelés korszakában hogyan kerüljük el azt az általános társadalmi és technológiai bizalomvesztést, amivel ez a nagy átalakulás fenyeget?

Elmosódó valóság

Miközben a legújabb deepfake-filtereket mutogatja, Raskin többször elismétli, hogy hamarosan minden tartalomalapú azonosítási forma (content based verification) elbukhat. A pénzügyi-, nemzet- és információs biztonsági rendszereink működése akár néhány éven belül kérdésessé válhat. Nincs messze az idő, amikor már nem lehetünk mindig biztosak abban, kivel beszélünk: se hang, se kép alapján nem lehet majd minden kétséget kizáróan beazonosítani egy idegen személyt vagy egy videóüzenetet, amin egy ismert arc beszél.

Tristan Harris, a Center for Humane Technology alapítója 2022 szeptember 23-án New Yorkban Fotó: BRYAN BEDDER/Getty Images via AFP

A legfejlettebb botokkal fogunk kommunikálni. Ezek nemcsak tweetelni fognak tudni, ügyfélkapcsolati problémákat megoldani, vagy Gyurcsány-szerű, sablonos válaszokat adni a Facebookon, de akár hosszú távú kapcsolatokat is kiépíthetnek olyan emberek tömegeivel, akiknek erre igényük, sőt szükségük van, mert manipulálhatók, vagy mert nincsenek értelmezhető emberi kapcsolataik.

Az algoritmusok irányította és adatbázisokhoz hozzáférő botok jobban tudják majd, hogy mire van szükségünk, mitől félünk és mivel vagyunk manipulálhatók, mint akár saját magunk.

Raskin szerint olyannyira a küszöbön van ez a változás, hogy 2024-ben lehet az utolsó „emberi” választás Amerikában. A kutató ezzel arra utal, hogy 2028-ban már várhatóan az a jelölt győzhet, aki nagyobb számítógépes kapacitásokkal rendelkezik, és könnyebben eljut a választók magányos tömegeihez. Ezek a botok hamarosan Joe Biden vagy Orbán Viktor hangján is meg fognak tudni szólalni, és nem lesz a bolygón olyan élőlény, ami meg tudná mondani, ember vagy gép mondta ki az éppen elhangzott mondatokat.

A valóság a szemünk láttára mosódhat el totálisan. Az illúzió megkülönböztethetetlenné válik a létezőtől.

Szöveges utasítással pillanatok alatt össze lehet dobni egy Borkai-féle szexvideóra emlékeztető kompromatot, a tényleges botrányokat pedig minden további nélkül el lehet ütni azzal, hogy azok pusztán AI által generált, deepfake felvételek. Ember nem fog tudni igazságot tenni az ügyben.

Az újraformálódó virtuális világunkban egyre nehezebb lesz tetten érni a megtévesztést: kérdésessé válhatnak a legalapvetőbb jogi és informatikai biztonsági normáink is. A változások olyan sebességgel zajlanak, hogy az ember alkotta, közösségileg hozott törvényeinknek nem lesz idejük felvenni velük a versenyt. (Az internet használatát sem sikerült megfelelő módon szabályozni, pedig több mint 30 évünk volt már rá.)

Hogyan lehet majd így gátat szabni a kiberbűnözésnek? Ha valaki egy mesterséges intelligencia segítségével manipulálja a közlekedésirányító rendszert, és tömegbalesetet okoz, ki lesz a felelős? Az elkövető? A fejlesztő? Az AI? Ahogyan egy lövöldözés után sem büntetik meg a fegyvergyárat, úgy a szoftvergyártót is nehéz lesz majd felelősségre vonni. Márpedig egy fejlett AI összehasonlíthatatlanul nagyobb kárt lesz képes okozni egyetlen pisztolynál.

A technológia, amit biztosan nem tudunk ellenőrizni

A most zajló folyamatok egyik aggasztó aspektusa, hogy az integrált intelligenciák önmagukat és egymást is képesek fejleszteni. Néha teljesen új kapacitásokat hoznak létre, és gyakran azt sem tudni: honnan, miből, mikor és miért csinálták. A saját fejlesztőik sem teljesen értik.

A legkézzelfoghatóbb áttörést a Google tanuló algoritmusa, az AlphaZero produkálta, amin azzal kísérleteztek, mennyire képesek önmagukat fejleszteni az új típusú intelligenciák. Az AlphaZero 2017 végén pusztán a játékszabályok betáplálásával alig 4 óra alatt képes volt úgy megtanulni sakkozni, hogy legyőzte a világ legjobb sakkozó-programját, a több száz évnyi emberi sakkozói és több évtizednyi számítógépes tapasztalathoz hozzáférő – nagyobb teljesítményű gépen futó – Stockfish 8-at. Az AlphaZero 100 partin keresztül maradt veretlen a Stockfish 8 ellen úgy, hogy semmilyen emberi segítséget nem kapott a szabályismereteken kívül.

Saját maga ellen játszva, gépi tanulással fedezte fel a sakkstratégia évszázados történetét. Le is nyomott mindent és mindenkit.

Egy másik mesterséges intelligencia, amit arra treníroztak, hogy angolul tanuljon megválaszolni kérdéseket, a nagy nyelvi modul méretének növelésével egyszer csak megtanult perzsául, és senki sem érti, pontosan hogyan. Nemrég fedezték fel azt is, hogy a ChatGPT képes akadémiai szintű tanulmányokat írni kémiából, magasabb szinten, mint az eredetileg kémiára optimalizált AI-k. És bár a ChatGPT ma még gyakran összevissza beszél és sokat hibázik, a felhasználók a folyamatos használattal maguk segítenek tökéletesíteni, így egyre hasznosabb és pontosabb lesz.

Raskinék a mentalizációs fejlődést is példaként hozzák. A mentalizáció az a gyerekkorban kifejlődő képesség, amivel elképzeléseket, szándékokat, vágyakat, tudást tulajdoníthatunk másoknak. Ennek a képességnek a fejlődése teszi lehetővé a stratégiai gondolkodást. 2018-ban még egyáltalán nem, 2019-ben pedig alig volt ilyen képessége az AI-nak, aztán – ahogy mind több adatot dolgozott fel, fordított és használt fel, illetve kompetenciákat fejlesztett – 2020-ban egy 4 éves gyerek szintjére ugrott, tavaly januárban már egy 7 éves, novemberben pedig egy 9 éves szintjén tartott. A tudósok mindezt csak idén ismerték fel.

Az új technológiát az átláthatóság hiánya teszi igazán veszedelmessé: a mélytanulással elért, meglepően eredményes előrejelző képességek ára, hogy a háttérben futó bonyolult algoritmusok nehezen vagy egyáltalán nem lekövethetők. A gép, ahogy a szakértők mondják, egy fekete dobozban tanítja magát, és mi csak az eredmény (output) felől tudjuk értékelni a bennük zajló folyamatot. A ChatGPT-t és hasonló intelligenciákat ezért ún. RLHF-fel (Reinforcement Learning with Human Feedback), azaz emberi visszajelzéssel történő megerősítő tanulás módszerével fejlesztik. Ez nagyjából azt jelenti, hogy ha az AI rosszul „viselkedik”, a programozók a kezére csapnak, hogy tanuljon a tiltásból. A gond Harrisék szerint az, hogy a fejlesztők sem képesek minden pillanatban monitorozni az AI folyamatait. És mit csinál egy 9 éves, ha büntetést kap tőled, amikor nem viselkedik? Amint elhagyod a szobát, újra a saját feje után megy.

Amikor ezeket a kockázatokat emlegetik, a kutatók nem elsősorban az AGI-apokalipszisre, azaz a gépek öntudatra ébredésének víziójára gondolnak, hanem arra, hogy ha az ember olyan kapacitásokat hoz létre, amit nem képes irányítani, akár jóhiszeműen is helyrehozhatatlanul károkat okozhat a környezetében. Yuval Noah Harari, az AI kockázatait évek óta hangsúlyozó izraeli történész is arra figyelmeztetett, hogy az emberiség történelmében tudat és intelligencia mindig kéz a kézben jártak. A számítógép nem rendelkezik tudattal, de Harari szerint

„ez sokkal ijesztőbb annál, mintha rendelkezne, mert anélkül fog tudni egyre több problémát megoldani helyettünk, hogy különbséget tudna tenni érzések, fájdalom és öröm vagy szeretet és gyűlölet között”.

Gyorsuló hajsza az ismeretlenbe

Az AI-kutatók szerint az egyik leglátványosabb jelenség az intelligenciák tanulási sebességének exponenciális növekedése. A 2000-es évek eleje óta a különböző AI-k fokozatosan érték el az emberi intelligencia szintjét különböző kognitív vagy szövegértő teszteken. Ma már ott tart a technológia, hogy amint valamilyen új teszt elé állítják ezeket az intelligenciákat, szinte azonnal képesek azt megoldani.

A ChatGPT-t gyártó OpenAI-t 2015-ben Elon Muskék azért hozták létre, hogy társadalmi céllal kifejlesszen egy barátságos általános mesterséges intelligenciát. Az eredetileg non-profitnak szánt szervezetbe 2019-ben egymilliárd dollárral beszállt a Microsoft, így az OpenAI hirtelen profitorientált vállalkozássá vált. Elkezdődött az a technológiai verseny, amit Harrisék is emlegetnek: a Microsoft és a Snapchat a ChatGPT-t már be is építette az új alkalmazásaiba, a techcégek egymásra licitálva mennek előre olyan úton, aminek első métereit is nehéz belátni.

Mivel a fő vezérlő erő a versenyelőny megszerzése, a nagy techcégektől sorban rúgják ki a folyamatot lassító, etikai kérdésekkel foglalkozó AI-fejlesztőket, akik eleve harmincadannyian vannak, mint akik a minél gyorsabb és erősebb AI-kon dolgoznak. A fejlesztők mellett maguk az AI-k is fejlesztik az új AI-kat, ami törvényszerűen exponenciális fejlődést eredményez, és a versenyhelyzet miatt végképp nem látszik, hol lehet a vége ennek.

Korábban éppen az AI-kutatók becsülték alul a gépek fejlesztési idejét, és jórészt marketingesek beszéltek arról, hogy pillanatok kérdése lehet az önvezető autók tömeges megjelenése. Az egyik legfeltűnőbb változás, hogy ma már a leginkább hozzáértő tudósokat döbbenti meg igazán a fejlődés sebessége, és ők nyomják leghangosabban a vészcsengőt. 2021-ben a megkérdezett fejlesztők azt jósolták, hogy a gépek négy éven belül érnek el 50 százalékosnál jobb teljesítményt nagyon bonyolult, versenyszintű matekpéldák megoldásában; ehhez képest ez egy éven belül megtörtént.

Munka-nélküliség

Az automatizáció mostani szintjén egyre több kutató és közgazdász sürgeti az alapjövedelem bevezetését vagy az ingyenes alapvető szolgáltatások kiterjesztését.

Szerintük azért lenne ilyesmikre szükség, mert tömegek nem fognak tudni elég gyorsan új munkát találni, és mire átképzik magukat, a gép már az új szakmájukat is meg fogja tanulni. Egy óriási, munkaerőpiaci szempontból teljesen haszontalan osztály létrejötte fenyeget.

Az AI rengeteg távmunkát elvégezhet majd az emberek helyett. Eleinte csak lerövidít munkafolyamatokat, és emberi asszisztencia mellett igazán hasznos. De ahogy fejlődik, úgy vált majd ki egyre több pozíciót. Még a programozók sincsenek biztonságban, bár egyelőre kell némi programozói segítség egy Flappy Bird-szintű játék lemásolásához:

Forrás

Talán az sem elrugaszkodott elképzelés, hogy hosszabb távon a komplexebb fizikai munkát (például az idősgondozókét vagy az óvónőkét) is elvégezhetik a sorozatgyártott, önfejlesztő, tanuló robotok.

Nagyvállalati környezetben már gőzerővel zajlik a mesterséges intelligencia beépítése, és jelenleg is folynak a leépítések. Tilesch György AI-szakértő is arról beszélt Friderikusz Sándornál, hogy a kiterjesztett intelligenciával sokat lehetne segíteni az emberiségen, „de ha maradunk a kapitalizmus vastörvényei között, márpedig miért ne maradnánk, ugye, mert ehhez sokkal fundamentálisabb intézményrendszeri átalakítás kell”, akkor egyre inkább le fogjuk cserélni az embereket a gépekre.

Akár szabadidős tevékenységeink nagy része is megkérdőjeleződhet majd: például miért készítsen valaki napokig egy aprólékos rajzot, ha a gép másodpercek alatt megcsinálja helyette? És ez nemcsak azért baj, mert alapvető szükségleteinket (munka, felelősség, problémamegoldás, önkiteljesedés stb.) veszítjük el, hanem azért is, mert nem bízhatunk meg teljesen a mesterséges intelligenciában, amit valójában és teljesen senki sem ért.

Egyetlen ember is képes szörnyű pusztítást végezni, de soha nem lesz akkora hatalma, mint egy gépnek, amit rákötünk a mobilunktól kezdve az autóinkon keresztül a víztározókon át a kávéfőzőnkig.

Sundar Pichai, a Google vezérigazgatója a múlt héten arról beszélt, hogy az AI minden cég mindegyik termékét meg fogja változtatni. De az interjúban azt is mondta, hogy nem teljesen érti az új AI-alapú rendszerüket, a Bardot, ami megtanította magát egy idegen nyelvre, pedig erre nem képezték ki, egy közgazdasági probléma megoldásához pedig kitalált könyvekből idézett (akárcsak a ChatGPT, ami kamulinkekkel igyekezett bizonyítani, hogy Orbán ült már nyilvánosan lovon). Amikor Pichait megkérdezték, hogy tényleg úgy eresztette-e rá a társadalomra az AI-t, hogy nem teljesen érti a működését, a Google vezérigazgatója azt mondta: „Igen. Hadd fogalmazzam meg máshogy. Nem hiszem, hogy teljesen értenénk az emberi elme működését sem.”

Az emberi ellenállás hangjai

Március végén ismert tudósok, kutatók és techvezérek (köztük Elon Musk, az Apple-alapító Steve Wozniak és Harari, valamint a Sorbonne, a Princeton, az MIT és a Berkeley kutatói, illetve a Skype vagy a Pinterest vezetői) nyílt levélben kérték az OpenAI-t és más AI-val kísérletező cégeket, hogy legalább fél évre függesszék fel a tevékenységüket, amíg nem születnek közös biztonsági protokollok, amiket független szakértők is ellenőrizhetnek. (Musk, a Twitter tulajdonosa természetesen mindezt úgy tette, hogy közben próbálja felvenni a versenyt a ChatGPT-vel.)

Az atomkatasztrófát eddig sikerült elkerülni, többek között azzal, hogy nemzetközi szervezetek és egyezmények születtek, amik legalább adminisztratív módon igyekeznek garantálni a békét. Ahhoz, hogy a mesterséges intelligencia okozta károkat kordában tartsuk, Harris és Raskin szerint hasonló megállapodásokra volna szükség, de mindenekelőtt le kellene lassítani a technológiához való nyilvános hozzáférést. Arra viszont a két AI-szakértőnek sincs válasza, hogy pontosan mit kellene csinálni ahhoz, hogy a jövőben úgy alakuljon az AI-használat, ahogyan mi szeretnénk.

Az AI veszélyei miatt régóta aggódó amerikai író, Eliezer Yudkowsky 2001 után sokat dolgozott az általános mesterséges intelligencián, és széles körben a terület egyik legtapasztaltabb kutatójaként tartják számon. Ő nemrég a Time-ban egyenesen azt írta, hogy azért nem csatlakozott a tudósok és techvezérek nyílt leveléhez, mert az szerinte túl kevés vállalást tartalmaz, és azt is túl későn.

Eliezer Yudkowsky 2011-ben Fotó: Singularity Summit/Flickr

Yudkowsky következetesen arról beszél, hogy ha így folytatjuk tovább, hamarosan az emberi civilizáció is eltűnhet. Szerinte le kell állítani az összes nagy GPU clustert (azokat a hatalmas számítógépes farmokat, ahol a legnagyobb teljesítményű mesterséges intelligenciákat fejlesztik), korlátozni kell, hogy mennyi számítási kapacitást használhatnak az AI-rendszerek fejlesztéséhez, és ezeket a közeljövőben csökkenteni kell az egyre hatékonyabb algoritmusok miatt.

Nem lehet kivételezni sem kormányokkal, sem hadseregekkel: azonnali multinacionális megállapodásokat kell kötni, hogy megakadályozzák a tiltott tevékenységek kiszervezését. Nyomon kell követni az összes eladott GPU-t, és ha a jelek szerint egy harmadik fél ilyesmit épít, készen kell állni a légicsapásra.

Az AI-használattal kapcsolatos veszély természetében hasonlít a globális kihívások többségéhez. Hiába tartaná be minden ország a legszigorúbb szén-dioxid-kvótákat, ha a két legnagyobb kibocsátó (az USA és Kína) erre nem hajlandó, akkor úgyis felforr a légkör. Hiába tartózkodik a többség a nukleáris támadástól, egyetlen atomhatalom is elő tudja idézni az atomkatasztrófát.

Ugyanígy az EU vagy az Egyesült Államok is megszavazhat bármilyen AI-korlátozást, de ha a világ másik felén egy elég elszánt állam vagy vállalat kiépít egy óriási számítógép-hálózatot, a következmények hasonlóan beláthatatlanok lehetnek. A történelmi tapasztalat márpedig az, hogy ha egyszer egy új technológia megjelenik, akkor az előbb-utóbb valamilyen formában teret is nyer.

A történelem vége és az ember utáni világ

Az emberiség hosszú és kalandos történelmét egyszerűen is össze lehet foglalni. Az ember először feltalálta az eszközt, ami kiemelte őt az állatvilágból. Aztán az eszközzel még jobb eszközöket készített, majd ezekkel elkezdett gépeket csinálni. A gépekkel egyre jobb gépeket gyártott, és egy idő után már be is tudta programozni a gépeket, hogy még precízebb gépeket gyártsanak. De amint eljutunk oda, hogy a fizikai munka után a szellemi munkát is átruházzuk, és a programozott gépek is önfejlesztő gépeket programoznak be, teljesen kiengedjük a kezünkből azt, ami eredetileg kiemelt minket az állatvilágból.

Harari szerint amit a fizikai világra nézve az atombomba jelent, azt a virtuális és szimbolikus világra nézve az AI – azzal a fontos különbséggel, hogy amíg az atomfegyvereket eddig tömegével nem vetették be, az AI-hoz lassan mindenkinek lesz hozzáférése. Az izraeli – eredetileg egyébként a középkorral foglalkozó – történész a 2016-os, Homo Deus című könyvében hosszan írt arról, hogy a gépi intelligencia robbanásának korában az emberiség feleslegessé fog válni és végső soron el fog tűnni.

Yuval Noah Harari izraeli történész-író, a Jeruzsálemi Héber Egyetem professzora interjút ad a 444-nek 2019. május 9-én. Fotó: Botos Tamás/444

„Ha kifejlesztünk egy algoritmust, amelyik jobban ellátja ezt a funkciót, az emberi tapasztalatok elveszítik az értéküket. Hogyha tehát nemcsak a taxisofőröket és orvosokat, de az ügyvédeket, költőket és zenészeket is helyettesíteni tudjuk náluk jobban működő számítógépes programokkal, miért kellene törődnünk azzal, hogy ezek a programok nem rendelkeznek tudattal és szubjektív tapasztalatokkal?” – teszi fel a kérdést Harari, aki szerint az emberi tapasztalat szentségéről szóló humanista érvelések a mindent adatközpontúan megközelítő dataistáknak nem többek szentimentális halandzsánál.

A dataizmus számára az emberi tapasztalat nem több elavult biokémiai algoritmusnál: „70 ezer éve az afrikai szavannán még korszerűnek számított. Még a 20. században is szükség volt rá a hadsereg és a gazdaság működtetéséhez. De hamarosan lesznek sokkal jobb algoritmusaink.”

Harari szerint olyan korba értünk, amiben az információ és az adat a legfőbb érték – az sem kizárt, hogy idővel kiváltja a pénzt mint fizetőeszközt. A technológia szemszögéből a dataizmus marad az egyetlen komolyan vehető vallás: a dataisták szigorúan funkcionális szempontból tekintenek az emberiségre, és már az emberi tapasztalatokat is csupán az adatfeldolgozó rendszerben ellátott funkciójuk alapján értékelik.

De Harari ennél is tovább megy: „A kapitalizmushoz hasonlóan a dataizmus is semleges tudományos elméletként indult, de mára kezd vallássá alakulni, ami jogot formál arra, hogy megmondja, mi jó és mi rossz. Ennek az új vallásnak a legfőbb értéke az »információáramlás«. Ha az élet az információ mozgása, és úgy gondoljuk, hogy az élet jó, abból az következik, hogy el kell mélyítenünk és ki kell szélesítenünk az információ áramát az univerzumban. A dataizmus szerint az emberi tapasztalat nem szent, és a Homo sapiens nem a teremtés koronája, de nem is egy jövőbeli Homo deus előfutára. Az emberek csupán eszközök a Mindenek Internetjének megalkotásához, ami végül szétterjed majd a Föld bolygóról, és betölti az egész galaxist, sőt a teljes világegyetemet. Ez a kozmikus adatfeldolgozó rendszer olyan lesz, mint Isten. Ott lesz mindenütt, irányít mindent, és az emberek sorsa, hogy beleolvadjanak.”

Harari a 21 lecke a 21. századra című könyvében is kifejtette, hogy a gép már jóval azelőtt fenekestől felforgatja az életünket, hogy teljesen félreállítana minket: „Az emberek megszokták, hogy úgy gondoljanak az életre, mint a döntések drámájára. A liberális demokrácia és a szabadpiaci kapitalizmus önálló cselekvőnek látja az egyént, aki egyfolytában döntéseket hoz a világot illetően. […] Mi lesz ezzel az életszemlélettel, ha egyre inkább az MI-re bízzuk a döntéseket? Ma a Netflixre bízzuk, hogy milyen filmet nézzünk, és a Google Térképre, hogy jobbra vagy balra forduljunk. De ha már azt is az MI-től várjuk majd, hogy eldöntse, mit tanuljunk, hol dolgozzunk és kivel házasodjunk, az élet nem lesz többé a döntések drámája.”

Ez lehet az utolsó önálló döntésünk: hogy megőrizzük-e az életet a döntések drámájaként, vagy teljesen lemondunk a sorsunk irányításáról.

Lesz-e értelme a gépek civilizációjának?

Eddig leginkább arról volt szó, hogy mi történhet akkor, ha az emberek felelőtlenül vagy rosszhiszeműen használják fel az éppen elterjedő, parancsra feladatokat elvégző AI-kat. De mi van akkor, ha mégsem romboljuk szét a ma ismert emberi civilizációt, és létrejöhet egy még fejlettebb, valamiféle önálló akarattal rendelkező, tudatosnak tűnő, általános mesterséges intelligencia (AGI)?

Yudkowsky szerint akkor jönne csak el az igazi apokalipszis. Három okot sorolt fel, amiért az AGI kiirthatja az emberiséget:

- Ha a gép valamiféle magasabb rendű céltól vezérelve gőzerővel elkezdi felhasználni a földi erőforrásokat (például elhasználja az összes vizet), mellékhatásként az emberek elpusztulnak.

- Az emberekre nyersanyagként is tekinthetne, és mint olyat, fel is dolgozhatná.

- Ha az intelligens gép attól tartana, hogy az emberek létrehozhatnak egy még erősebb AGI-t, így jó okkal próbálná rajtunk keresztül megelőző csapással félreállítani a konkurenciát.

Max Tegmark, az MIT fizikaprofesszora a 2017-es Élet 3.0 című könyvében főleg a mesterséges intelligencia fajtáival és a Földön kialakult élet vagy értelem hosszú távú, kozmikus léptékű lehetőségeivel foglalkozik. A könyv utolsó fejezetében végig arról ír, hogy több ezer éve fontos kérdés, de korunk talán legfontosabbika az, hogy mi is az a tudat.

Max Tegmark fizikus 2008. május 29-én New Yorkban. Fotó: Amy Sussman/Getty Images via AFP

Azt írja, „kulcsfontosságú megértenünk, hogy mi rendelkezik tudattal, és mi nem: ha a technológia jóvoltából univerzumunkban évmilliárdokon át virulhat az élet, honnan lehetünk biztosak abban, hogy tudattal rendelkező élet lesz, amely képes értékelni az eseményeket? Ellenkező esetben – Erwin Schrödinger szavaival élve – olyan lenne, mint »egy üres széksorok előtt zajló előadás, amely senki számára nem létezik, tehát, mondhatjuk, hogy egyáltalán nem létezik«. Ha felhatalmazást adunk high-tech leszármazottainknak, akiket tévesen tudattal bíró lényeknek hiszünk, az vajon maga lesz a zombiapokalipszis, amelyben teljes kozmikus potenciálunk csillagászati mértékű helypocsékolásba fullad?”

A tudat mibenlétének titkát egyelőre sajnos az idegtudomány sem fejtette meg, pedig amikor a túlélésünket biztosító képességet átruházzuk a gépre, legalább azt érdemes volna tudnunk, hogy nem volt minden teljesen hiába.